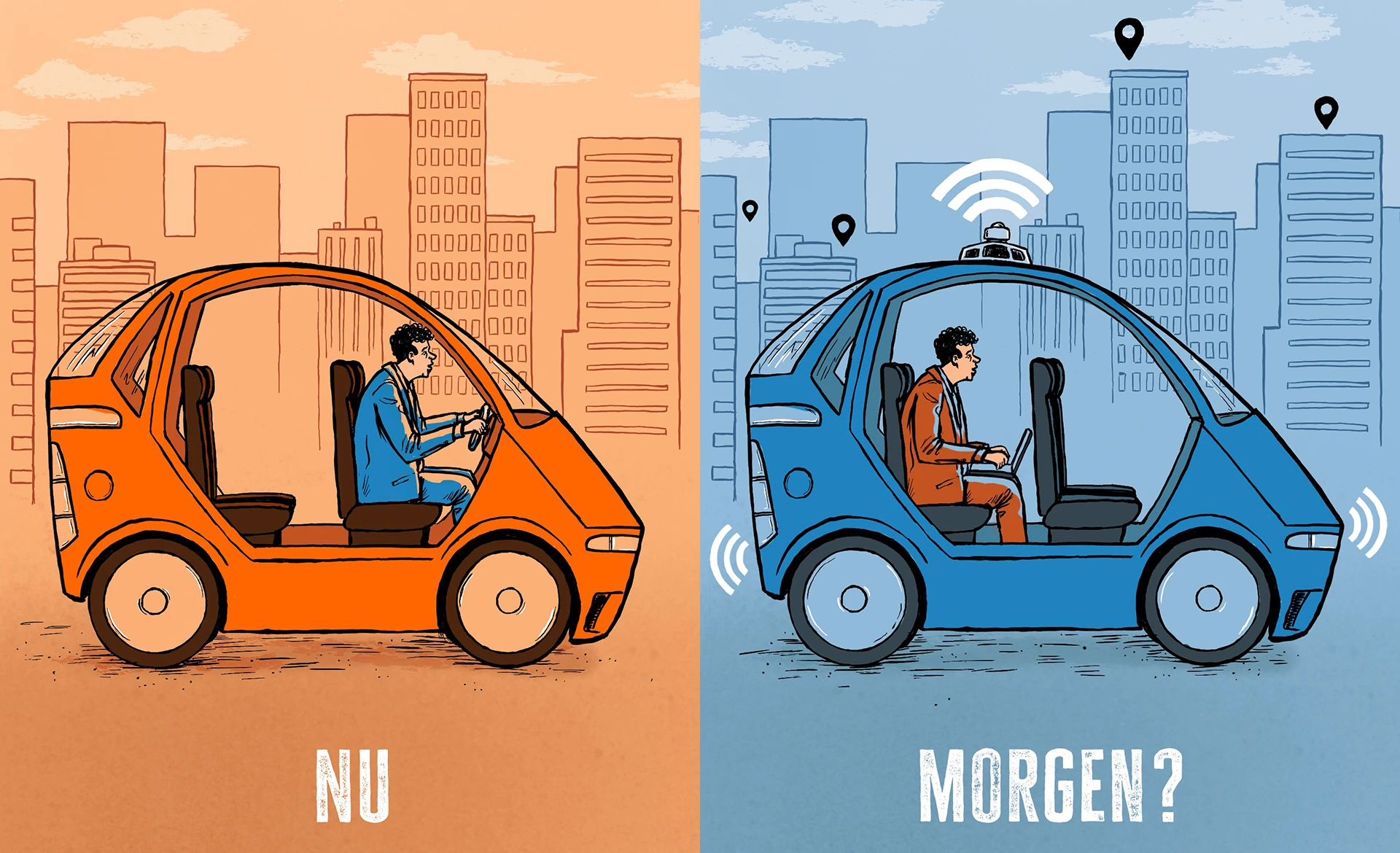

De zelfrijdende auto moet het lab uit

Nederland kan een belangrijke rol als testland voor zelfrijdende auto’s vergeten wanneer de wet- en regelgeving daar onvoldoende mogelijkheden toe biedt. Meer in het algemeen remt deze lacune ook Nederlands onderzoek naar en ontwikkeling van de nieuwste artificial intelligence.

Tekst: Alfred Monterie Beeld: Marc Weikamp

Zelfrijdende voertuigen zijn een belangrijk speerpunt voor de ai-ontwikkeling in Nederland. Daarom moet er snel een groot gebied komen om systemen zoals autonome bussen, bestelwagens, robot-taxi’s en ook auto’s zonder chauffeur gewoon veilig en in realistische omstandigheden te testen, aldus diverse experts.

Transformer-architectuur

Qua vooruitgang is de wisselwerking tussen ai en geautomatiseerd vervoer op de openbare weg groot. Bij de nieuwe end-to-end ai, een vorm van deep learning – waarbij zogenaamde foundation models worden getraind – is er geen mens meer nodig om de oplossing voor de zelfrijdende functie te programmeren. De oplossing komt uit data, gebruikmakend van een generieke architectuur voor kunstmatige neurale netwerken, de zogenaamde transformer-architectuur. Het model leert uit de data alle stappen te maken tussen de sensors (voor de input) en de actuatoren (voor de output). Gijs Dubbelman, head of Mobile Perception System lab (TU/e): ‘De ai komt dus zelf achter de beste oplossing.’

Belangrijke toepassingen van end-to-end ai liggen bij ‘computer vision’ en robotica, het leren van ‘control policies’ uit sensor-data. Voor de training van deze ai zijn veel data nodig, zegt Jan-Pieter Paardekooper, research scientist integrated vehicle safety bij TNO. Daarvoor moet het zelfrijdende voertuig uiteindelijk uit het lab komen. Te beperkt is de campus van de universiteiten zoals die van Delft en Eindhoven waar veel onderzoek op dit gebied wordt gedaan. De openbare weg kent een veel grotere verscheidenheid aan situaties waar dit soort auto’s op moeten worden voorbereid.

‘Ook de Rijksdienst voor het wegverkeer (RDW) zou zich meer moeten richten op het mogelijk maken van grootschalige en langdurende testen’

Gijs Dubbelman, head of Mobile Perception System lab (TU/e)

Gijs Dubbelman: ‘We staan te popelen om samen met de industrie hiermee aan de slag te gaan.’ Hij hoopt dan ook zeer dat een nieuw kabinet gehoor geeft aan de oproep uit het Nationaal AI Deltaplan om een speciale economische zone in te richten waar op grote schaal kan worden getest. Ook de Rijksdienst voor het wegverkeer (RDW) zou zich meer moeten richten op het mogelijk maken van grootschalige en langdurende testen. Nu heeft die dienst de focus op het toelaten van nieuwe automodellen die mogen worden verkocht, wat heel iets anders is.

Menselijk gedrag

Veel onderzoek naar mobiliteit en kunstmatige intelligentie wordt gedaan bij het Automated Driving lab (AUDRl) dat valt onder het Eindhoven Artificial Intelligence Systems Institute (EAISI) aan de TU/e. EAISI-directeur Carlo van de Weijer ziet ai-oplossingen niet alleen bijdragen tot betere zelfrijdende voertuigen, maar ook het hele mobiliteitssysteem veiliger maken.

AUDRI werkt aan systemen die op basis van sensoren zien wat er in de verkeersomgeving ofwel de buitenwereld gebeurt. Naast de observatie verbetert ai ook de interpretatie van beelden. ‘Ai is daar erg goed in,’ aldus Paardekooper. Net als mensen die op hun ogen zijn aangewezen, leert het systeem steeds beter wat iets is en hoe gevaarlijk dat is. Als er een matras op de weg ligt, kan een risico ontstaan. Een lading stenen die van een vrachtwagen valt, vormt een nog groter gevaar. De zelfrijdende auto moet snel beslissen of hij afremt dan wel erom heen rijdt. Het afgelopen jaar is ai tegelijk ook aanzienlijk beter geworden in het nemen van beslissingen; de planning van het pad dat het voertuig moet nemen zoals het veranderen van rijbaan. Het is kijken, denken en uitvoeren. Meerdere modules zijn daarbij betrokken.

Paardekooper: ‘We zien ook dat als je veel voorbeelden hebt van menselijk gedrag, de neurale systemen op die data zijn te trainen. End-to-end learning leidt tot het meest menselijke gedrag van de auto. Data van niet-zelfrijdende auto’s kunnen de autonome voertuigen beter maken. De sensor kan voorbeelden halen uit het gedrag van de menselijke bestuurder.’

Data

Machine learning-modellen analyseren sensordata om te voorspellen hoe objecten zullen bewegen en om veilige rij-acties te bepalen. Dit bootst het menselijk oordeel na, maar dan op machinesnelheid. Prof. Theo Gevers, hoogleraar Computer Vision (UvA): ‘Snel valt te voorspellen of voetgangers al dan niet oversteken. Vergeleken met menselijke bestuurders gaat de reactiesnelheid omhoog. Want deze systemen kunnen heel snel alle kanten op kijken. Ze kunnen steeds beter voorspellen hoe voetgangers op straat en langs de weg bewegen en wat er fout kan gaan. Zonder ai zouden voertuigen complexe omgevingen niet kunnen interpreteren of zelfstandig beslissingen kunnen nemen.’

Behalve ruwe data afkomstig van automerken waarmee TomTom een contract heeft, komen ook heel veel metadata binnen via een soort crowdsourcing. Ai-algoritmen verwerken deze informatie om objecten zoals voetgangers, verkeerslichten en andere voertuigen te detecteren en te classificeren.

3D-waarneming

Veel wetenschappelijk onderzoek richt zich momenteel op 3D-waarneming. Het maakt Nederland tot een broedplaats van dit soort ai-onderzoek. Computer vision stelt systemen in staat om heel snel achter elkaar beslissingen te nemen.

Zeker als de auto snel rijdt en de omgeving in hoog tempo verandert, is het een uitdaging om de algoritmen in de pas te laten lopen. De Universiteit van Amsterdam doet veel onderzoek om de 3D-ruimte beter te kunnen begrijpen. Drukke straten in binnensteden geven een complex beeld met voetgangers, fietsers en veel ander verkeer. Die dynamische werelden vragen om simultane waarnemingen waarbij zeer grote hoeveelheden data vereist zijn. Ook moet voor problemen zoals mistvorming een oplossing worden gevonden. Goed kaartmateriaal draagt er mede toe bij dat zelfrijdende auto’s veel veiliger zijn. Gevers, tevens co-director van het Atlas Lab (UvA-TomTom): ‘De zelfrijdende auto’s van Waymo rapporteren 92 procent minder letselclaims dan menselijke gebruikers.’

‘Ai moet data van verschillende sensoren zoals een camera, GPS, radar of LiDAR combineren tot één betrouwbaar beeld van de omgeving’

Prof. Theo Gevers, hoogleraar Computer Vision (UvA)

Kaarten

Cruciaal voor autonome voertuigen is nauwkeurig kaartmateriaal. Prof. Theo Gevers: ‘Alles moet kloppen; de waarnemingen en de beslissingen vanuit de auto. Ai moet data van verschillende sensoren zoals een camera, GPS, radar of LiDAR combineren tot één betrouwbaar beeld van de omgeving. Een zelfrijdende auto moet een kaart van de omgeving opbouwen. Hij dient te weten waar alles staat, terwijl tegelijkertijd zijn positie binnen die kaart wordt bepaald. Dit proces heet SLAM wat staat voor Simultaneous Localization and Mapping.’

De eerdergenoemde end-to-end ai-modellen maken ook steeds meer gebruik van een zogenoemde ‘open vocabulary’. Ze kunnen daardoor situaties herkennen die niet in de dataset zitten maar wel op andere soorten ‘foundation models’ zijn getraind. Dankzij deze vorm van ai zijn de kaarten te verrijken met dingen die niet eerder zijn gezien, bijvoorbeeld bijzondere objecten die op het wegdek liggen.

Meer testmogelijkheden

Alle geïnterviewden benadrukken het belang van meer testmogelijkheden. Zeker bij weinig voorkomende of extreme incidenten is het belangrijk dat het systeem een soortgelijke situatie heeft meegemaakt. Hoe meer data, des te groter de kans dat de auto juist reageert. Daarom hebben testen met bijvoorbeeld robot-taxi’s zoveel nut. Alleen al in San Francisco en omgeving maken die 250.000 ritten per week, wat een schat aan data oplevert. De grote uitdaging is de interactie met het tegemoetkomende verkeer. Automobilisten kunnen de chauffeur van de tegenligger aankijken en hun beslissingen daarop afstemmen. De vraag is hoe je dat doet met auto’s die zelf rijden.

Tot de bedrijven die van meer ruimte tot experimenten kunnen profiteren, behoren chipmaker NXP, TomTom, bussenbouwer VDL en DAF Trucks. NXP werkt aan het goedkoper maken van de LiDAR (light detection and ranging), een apparaat dat laserpulsen uitstuurt en de afstand berekent door de terugkaatsing-tijd te meten. De nauwkeurigheid is erg hoog, wat de techniek geschikt maakt voor 3D-kaarten en autonome voertuigen. Mobiliteitsdeskundige Van de Weijer: ‘Nu kost zo’n compleet LiDAR-systeem duizenden euro’s. Het streven is de prijs onder 100 euro te drukken.’

Ook Gevers ziet zelfrijdende auto’s als een speerpunt voor ai. Hierdoor wordt snelle vooruitgang geboekt bij het redeneren in 3D, het combineren van multimodale camera’s en LiDARs en het trainen van taalmodellen op video voor classificatie. Ook nieuwe methoden zoals Gaussian Splatting (GS) zijn te leren uit 2D-beelden. Al video-opnamen makend kun je met de eerder genoemde SLAM-omgevingen steeds preciezer en sneller in 3D reconstrueren. Door meer 2D-camerabeelden op te nemen zijn die kaarten verder te perfectioneren met nieuwe GS- en SLAM-technieken. Dankzij ai wordt snelle vooruitgang geboekt, aldus de Amsterdamse hoogleraar.

‘Alles is te zwaar gereguleerd waardoor zelfrijdende auto’s, ook met een chauffeur erbij, niet gemakkelijk de openbare weg op kunnen’

Gijs Dubbelman, head of Mobile Perception System lab (TU/e)

Veiligheid

Testen met testrijders levert veel inzichten op. Maar het schort nog aan de uitlegbaarheid van deze ai. En het is nog moeilijk om op basis hiervan de veiligheid te garanderen. Dit soort ai valt onder de hoog risico-toepassingen waarvoor de strengste regels gelden. Het systeem leert om mensen na te doen, maar leert daar geen verkeersregels uit te halen. De zelfrijdende auto leert (nog) niet de basis waarop mensen autorijden. Anders gezegd: het is lastig te bepalen hoe ze reageren. Het zomaar de weg op sturen van deze voertuigen is nog een veiligheidsrisico, aldus Paardekooper. Net als ChatGPT kunnen deze systemen soms nog hallucineren.

Mogelijk biedt hybride ai soelaas. Het idee is lerende systemen te combineren met systemen die kunnen redeneren. ‘Dit houdt in dat een extra veiligheidslaag wordt toegevoegd die ervoor zorgt dat hallucinaties worden ontdekt. Het systeem krijgt zo extra vangrails. Hybride ai voegt expliciet verkeersregels toe. En impliciet komen er regels bij voor gewenst gedrag van automobilisten. Die geven aan hoe mensen het beste met elkaar omgaan in het verkeer. Dit kan per land verschillen. De afstand tussen auto’s is in Nederland bijvoorbeeld kleiner dan elders. Er zijn ook ongeschreven regels.’

Belemmeringen

Volgens Gijs Dubbelman ligt de EU op gebied van autonome voertuigen mijlenver achter op de VS en China, uitgezonderd het Britse Wayve. Alles is te zwaar gereguleerd waardoor zelfrijdende auto’s, ook met een chauffeur erbij, niet gemakkelijk de openbare weg op kunnen. Daardoor wordt de achterstand nog groter. Voor zover hier kennis aanwezig is, is het testen van nieuwe technologie bijna onmogelijk. De Nederlandse wetgeving vormt een belemmering, terwijl niemand de verantwoordelijkheid durft te nemen om ruimte te scheppen. De betrokken rijksdienst heeft ook weinig begrip van hoe ai zich ontwikkelt. Het feit dat je niets in de ai-software mag veranderen tijdens het hele testtraject, werkt remmend. De praktische uitrol schiet daarom niet op. De behoefte aan een automatische testomgeving is groot. In Duitsland en België is het testen met R&D-voertuigen makkelijker.